La jueza le preguntó al Pentágono por qué baneó a Anthropic y el DOD no tuvo respuesta: lo que pasó en la corte de San Francisco

El ejército de EUA usó Claude para identificar 1,000 blancos en Irán mientras el gobierno lo tiene baneado. Ayer la jueza Rita Lin presionó al Pentágono y dijo lo que todos pensaban: esto parece un intento de aplastar a Anthropic.

El ejército de los Estados Unidos usó Claude para identificar más de 1,000 blancos militares en Irán durante las primeras 24 horas de ataques. El mismo Claude que el gobierno de Trump tiene oficialmente baneado. Si eso no te parece una contradicción absurda, espera a escuchar lo que pasó ayer en la corte federal de San Francisco.

La audiencia que nadie del Pentágono quería tener

El 24 de marzo, los abogados de Anthropic se presentaron ante la jueza federal Rita Lin para pedir una medida cautelar: que se pause temporalmente la designación del Departamento de Defensa (DOD) que clasifica a Anthropic como un “riesgo en la cadena de suministro”. La jueza los escuchó a todos, y luego soltó lo que muchos ya pensaban.

“Me parece problemático,” dijo Lin. “Estas tres acciones no parecen estar calibradas para atender la preocupación de seguridad nacional que se menciona. Si el problema es la integridad de la cadena de mando operacional, el Pentágono simplemente podría dejar de usar Claude.”

Y remató: “Parece un intento de aplastar a Anthropic.”

CNBC reportó en vivo desde la audiencia que la jueza presionó directamente al abogado del gobierno, Eric Hamilton, cuestionando si el DOD violó la ley al usar una designación que normalmente se reserva para entidades extranjeras potencialmente hostiles. Aparentemente, es la primera vez en la historia que esta etiqueta se aplica contra una empresa estadounidense.

Hamilton respondió que el Pentágono “llegó a preocuparse de que Anthropic pueda en el futuro tomar acciones para sabotear o subvertir sistemas de TI.” Sin más pruebas. Sin más explicación.

¿Qué es eso de “supply chain risk” y por qué importa?

La designación de “riesgo en la cadena de suministro” no es cosa menor. Cuando el DOD pega esa etiqueta a una empresa, obliga a todos los contratistas de defensa, Amazon, Microsoft y Palantir entre ellos, a certificar que no hacen negocio con esa compañía en sus proyectos militares.

En la práctica: si eres un contratista que usa Claude en cualquier parte de tu stack, aunque sea para redactar documentos internos, tienes un problema legal enorme. The Hill confirmó que la etiqueta “threw agencies into limbo” ya que nadie sabe exactamente qué actividades están prohibidas y cuáles no.

Anthropic argumenta que esto le puede costar miles de millones de dólares en contratos. Y la jueza parece estar de acuerdo en que el mecanismo es desproporcionado.

El pedo de origen: Dario Amodei dijo que no

Todo empezó cuando Anthropic y el DOD estaban negociando el uso de Claude en la plataforma GenAI.mil del ejército. Las pláticas se fueron a la b cuando Anthropic puso sus condiciones: Claude no puede usarse para armas autónomas letales ni para vigilancia masiva de ciudadanos estadounidenses.

El CEO Dario Amodei lo dijo públicamente a finales de febrero. Trump respondió con un ban a nivel gobierno. Hegseth firmó la designación de “supply chain risk” días después.

El abogado de Anthropic, Michael Mongan, lo resumió bien en la audiencia: “Un saboteador no va a pelearse públicamente con el gobierno. Un saboteador se queda callado y hace el daño desde adentro.”

Es una lógica difícil de rebatir.

La contradicción que nadie en el DOD sabe cómo explicar

Aquí está el punto más arrecho de toda la historia: mientras el gobierno de Trump banea oficialmente a Anthropic y la etiqueta como amenaza nacional, el Comando Central de EUA (CENTCOM) estuvo usando Claude activamente para procesar imágenes satelitales, interceptaciones de señales e inteligencia de todo tipo en la campaña contra Irán.

Washington Post reportó que Claude fue usado para identificar más de 1,000 objetivos militares en las primeras 24 horas de ataques. The Hill lo confirmó por separado citando fuentes oficiales del Pentágono.

La justificación del DOD es que necesitan “tiempo razonable para reemplazar los sistemas”. Traducido: el ban es real, pero no tanto.

Palantir, uno de los principales contratistas del ejército, también sigue usando Claude. Su CEO Alex Karp lo dijo sin rodeos a mediados de marzo.

Esto no es solo una contradicción política. En términos legales, debilita significativamente el argumento del gobierno de que Anthropic representa una amenaza real para la seguridad nacional. Si fuera un riesgo tan serio, ¿por qué siguen usándolo para identificar blancos en una guerra activa?

¿Qué sigue después de la audiencia?

La jueza Lin dijo que espera emitir su resolución en los próximos días. Anthropic pidió un fallo antes del 26 de marzo, aunque el tribunal no está obligado a cumplir ese plazo.

Si Lin otorga la medida cautelar, la designación de “supply chain risk” queda suspendida mientras avanza el proceso legal. Si no la otorga, Anthropic tendrá que seguir lidiando con el daño comercial mientras el caso sigue en tribunales.

Los amicus briefs presentados al caso, analizados por TechPolicy.Press, incluyen a expertos en derecho y tecnología que argumentan que la designación no tiene sustento legal real.

¿Qué significa esto para quienes usamos Claude en LATAM?

La situación no afecta directamente a usuarios de Claude en México o LATAM, la API sigue funcionando y los precios no han cambiado. Pero hay implicaciones que vale la pena seguir.

Primero: si el DOD puede designar como “amenaza” a una empresa de IA estadounidense por negarse a cumplir ciertas peticiones de uso, eso establece un precedente preocupante sobre cómo los gobiernos pueden presionar a empresas tech para ceder en sus políticas de uso.

Segundo: Anthropic estaba en conversaciones avanzadas con grandes contratistas como Amazon Web Services para expandir Claude en servicios enterprise globales. Si el caso sale mal, esos contratos están en riesgo, y eso afecta el ritmo de adopción de Claude en la región.

Como ya cubrimos en nuestro análisis sobre Claude Code vs. Cursor y las herramientas de IA para programar, Claude tiene una de las posiciones más fuertes en el mercado enterprise precisamente por sus políticas de seguridad responsables. Ironicamente, esas mismas políticas son las que lo metieron en este lío.

Y hablando de presiones externas sobre las empresas de IA, este caso tiene eco directo en lo que ya advertíamos sobre si la burbuja de la IA está a punto de tronar: los vaivenes políticos son exactamente el tipo de riesgo que los analistas más conservadores están señalando.

Hay también una capa adicional: este caso podría sentar jurisprudencia sobre si el gobierno puede usar designaciones de seguridad nacional como herramienta de presión contra empresas que no ceden en sus políticas de uso. Eso va mucho más allá de Anthropic.

El fondo real del asunto

El argumento de Anthropic no es “el ejército no puede usar IA”. Es “el ejército no puede usar nuestra IA para cosas que nosotros consideramos inaceptables”. Eso es exactamente lo que hacen los contratos de licencia de cualquier software.

El Pentágono lo que quiere es acceso irrestricto sin rendir cuentas a nadie, ni siquiera al proveedor del servicio. Y cuando Anthropic dijo que no, la respuesta fue usar el aparato de seguridad nacional para presionar.

La jueza Lin parece haberlo entendido. El DOD, en cambio, no tuvo una respuesta convincente.

El fallo llega en cuestión de días. Estén pendientes.

¿Qué opinan de esto? ¿Anthropic hizo bien en plantar su postura o fue un error pelearse con el ejército? Tírenlo en comentarios.

Fuentes

- CNBC: Judge presses DOD on why Anthropic was blacklisted

- The Hill: Judge says Pentagon’s Anthropic ban looks like ‘attempt to cripple’ company

- CBS News: Judge calls Pentagon’s moves against Anthropic “troubling”

- Washington Post: Pentagon leverages AI in Iran strikes amid feud with Anthropic

- NPR: Judge says government’s Anthropic ban looks like punishment

- TechPolicy.Press: Breaking Down Amicus Briefs in Anthropic’s Fight with the Pentagon

- Responsible Statecraft: US used Claude to strike over 1000 targets in first 24 hours of war

Comentarios

No te pierdas ningún post

Recibe lo nuevo de Al Chile Tech directo en tu correo. Sin spam.

También te puede interesar

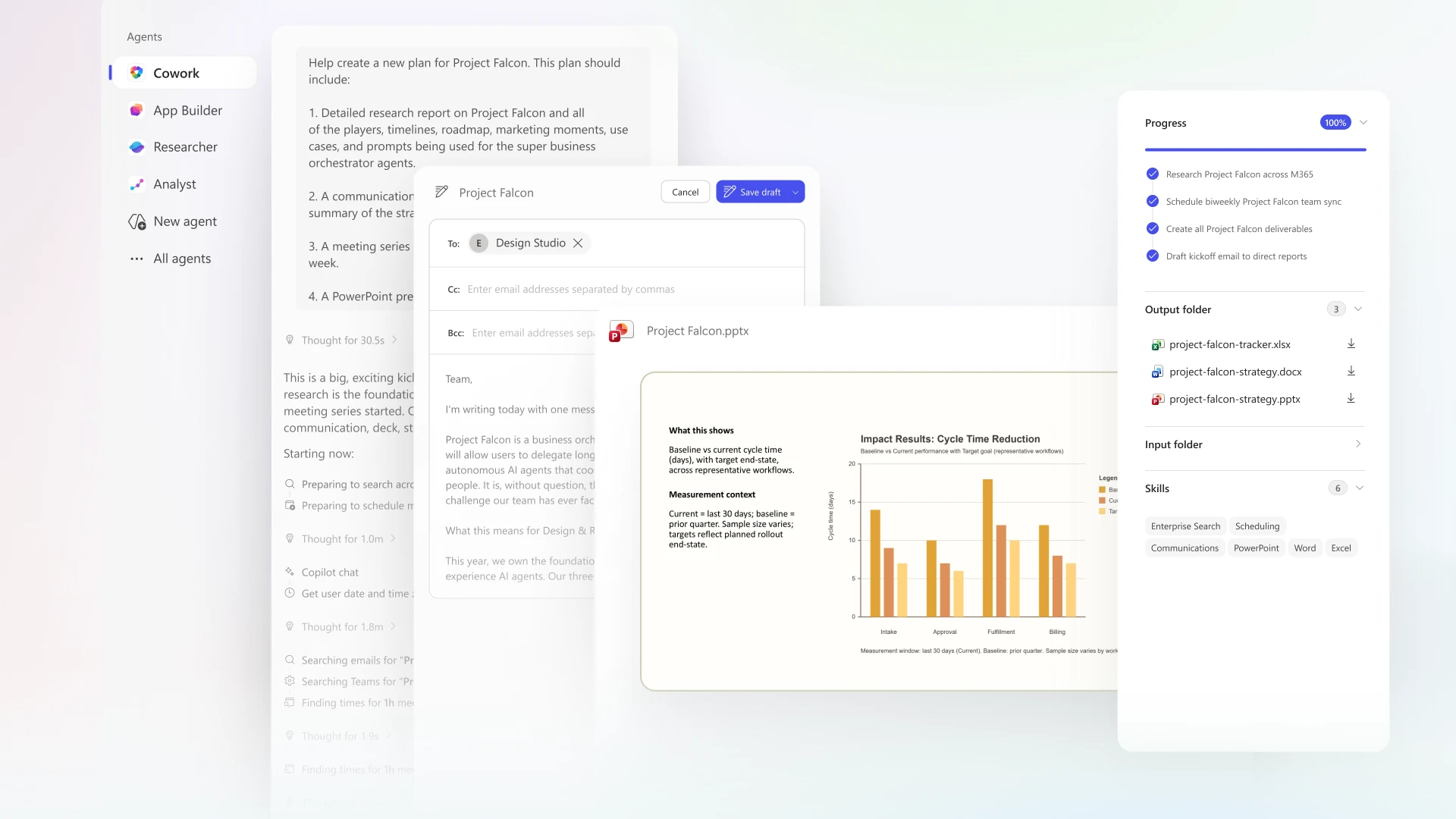

Microsoft le puso el cerebro de Anthropic a su producto estrella (y OpenAI no la está pasando bien)

Copilot Cowork es el nuevo agente de IA de Microsoft 365 y corre con Claude de Anthropic, no con OpenAI. Te explicamos qué hace, cuánto cuesta y por qué esto cambia todo.

Oracle despidió 30,000 personas con un email a las 6am: el mayor recorte de la empresa para pagar sus apuestas en IA

Oracle ejecutó el mayor despido de su historia el 31 de marzo, cortando 18% de su fuerza laboral global. México fue golpeado directo: 600 empleados del centro en Zapopan, Jalisco, se quedaron sin trabajo de la noche a la mañana.

La IA está encareciendo tu próximo celular en México: cuándo comprar, qué modelos evitar y qué esperar antes de que suban más

Los centros de datos de IA se están comiendo los chips de memoria del planeta. Resultado: celulares hasta 14% más caros en 2026, especificaciones recortadas y una caída récord en ventas. Guía práctica para consumidores en México.